В настоящее время идет гонка за создание искусственного общего интеллекта — футуристического видения машин, которые будут так же широко умны, как люди, или, по крайней мере, смогут делать многие вещи так же хорошо, как люди.

Достижение такой концепции, которую обычно называют AGI, является главной миссией компании OpenAI, создающей ChatGPT, и приоритетом для элитных исследовательских подразделений технологических гигантов Amazon, Google, Meta и Microsoft.

Это также повод для беспокойства мировых правительств. В четверг ведущие ученые в области ИИ опубликовали в журнале Science исследование, предупреждающее, что бесконтрольные агенты ИИ с навыками «долгосрочного планирования» могут представлять экзистенциальную опасность для человечества.

Но что же такое ИИ и как мы узнаем, когда он будет достигнут? Когда-то этот термин находился на задворках компьютерной науки, но теперь он стал нарицательным и постоянно переосмысливается теми, кто пытается его реализовать.

Что такое AGI?

Не путайте с похожим по звучанию генеративным ИИ, который описывает системы искусственного интеллекта, стоящие за множеством инструментов, «генерирующих» новые документы, изображения и звуки, — искусственный общий интеллект — более туманная идея.

Это не технический термин, а «серьезная, хотя и плохо определенная концепция», — говорит Джеффри Хинтон, ученый-первопроходец в области ИИ, которого прозвали «крестным отцом ИИ».

«Я не думаю, что есть согласие по поводу того, что означает этот термин», — сказал Хинтон по электронной почте на этой неделе. «Я использую его для обозначения ИИ, который, по крайней мере, не уступает человеку почти во всех когнитивных функциях, которые выполняет человек».

Хинтон предпочитает другой термин — суперинтеллект — «для AGI, которые лучше людей».

Небольшая группа ранних сторонников термина AGI стремилась вызвать в памяти то, как компьютерные ученые середины XX века представляли себе разумную машину. Это было до того, как исследования в области ИИ разделились на поднаправления, которые развивали специализированные и коммерчески жизнеспособные версии технологии — от распознавания лиц до голосовых помощников, распознающих речь, таких как Siri и Alexa.

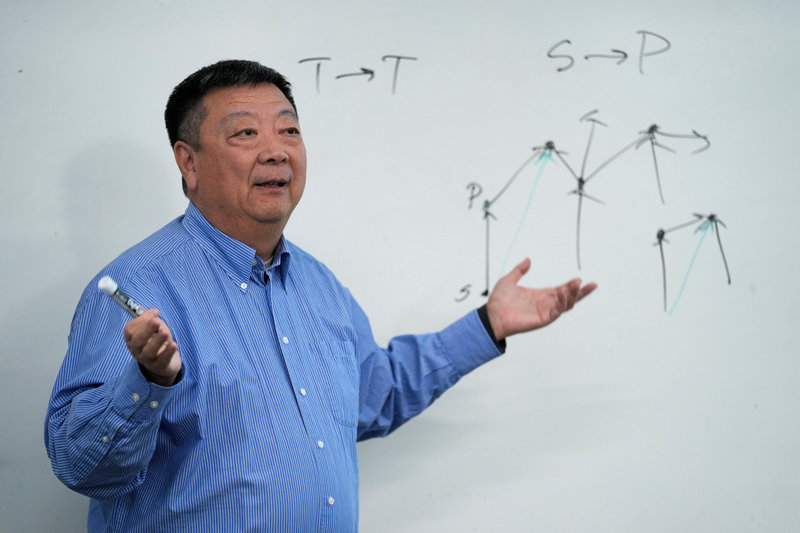

Основные исследования в области ИИ «отклонились от первоначального видения искусственного интеллекта, которое вначале было довольно амбициозным», — говорит Пей Ванг, профессор, преподающий курс AGI в Университете Темпл и помогавший организовать первую конференцию по AGI в 2008 году.

Добавление буквы «G» в AGI стало сигналом для тех, кто «все еще хочет делать большие вещи. Мы не хотим создавать инструменты. Мы хотим создать мыслящую машину», — говорит Ванг.

Мы уже достигли AGI?

Не имея четкого определения, трудно сказать, когда компания или группа исследователей достигнет искусственного интеллекта общего назначения — или уже достигла.

«Двадцать лет назад, я думаю, люди с радостью согласились бы с тем, что системы с возможностями GPT-4 или (Google) Gemini достигли общего интеллекта, сравнимого с человеческим», — говорит Хинтон. «Способность ответить на более или менее любой вопрос разумным образом прошла бы проверку. Но теперь, когда ИИ может это делать, люди хотят изменить тест».

Совершенствование методов «авторегрессивного» ИИ, предсказывающего наиболее правдоподобное следующее слово в последовательности, в сочетании с огромными вычислительными мощностями для обучения этих систем на огромном количестве данных, привело к созданию впечатляющих чат-ботов, но они все еще не совсем AGI, о которых многие думали. Для достижения AGI требуется технология, способная выполнять широкий спектр задач, включая рассуждения, планирование и способность учиться на опыте, не хуже человека.

Некоторые исследователи хотели бы прийти к консенсусу относительно того, как это измерить. Это одна из тем предстоящего в следующем месяце в Вене (Австрия) семинара по AGI — первого на крупной научной конференции по ИИ.

«Это действительно требует усилий и внимания со стороны сообщества, чтобы мы могли договориться о какой-то классификации AGI, — говорит организатор семинара Цзясюань Ю, доцент Иллинойского университета Урбана-Шампейн. Одна из идей — разделить его на уровни, подобно тому, как автопроизводители пытаются определить путь между круиз-контролем и полностью самоуправляемыми автомобилями.

Другие планируют разобраться в этом самостоятельно. Компания OpenAI из Сан-Франциско возложила на свой некоммерческий совет директоров, в состав которого входит бывший министр финансов США, ответственность за принятие решения о том, когда системы искусственного интеллекта достигнут того уровня, на котором они «превосходят человека в выполнении наиболее экономически выгодной работы».

«Совет директоров определяет, когда мы достигли AGI», — говорится в собственном объяснении структуры управления OpenAI. Такое достижение лишит крупнейшего партнера компании, Microsoft, права на коммерциализацию такой системы, поскольку условия их соглашений «распространяются только на технологии, предшествующие AGI».

Опасна ли AGI?

В прошлом году Хинтон попал в мировые заголовки, когда ушел из Google и выступил с предупреждением об экзистенциальных опасностях ИИ. Новое исследование, опубликованное в четверг в журнале Science, может усилить эти опасения.

Его ведущий автор — Майкл Коэн, исследователь из Калифорнийского университета в Беркли, который изучает «ожидаемое поведение в целом интеллектуальных искусственных агентов», особенно тех, которые достаточно компетентны, чтобы «представлять для нас реальную угрозу, опережая нас в планировании».

В интервью, данном в четверг, Коэн дал понять, что таких агентов долгосрочного планирования ИИ пока не существует. Но «у них есть потенциал» стать более продвинутыми, поскольку технологические компании стремятся объединить сегодняшнюю технологию чатботов с более продуманными навыками планирования с помощью техники, известной как обучение с подкреплением.

«Если дать продвинутой системе ИИ цель максимизировать свое вознаграждение и в какой-то момент лишить ее вознаграждения, это сильно стимулирует систему ИИ исключить человека из процесса, если у нее есть такая возможность», — говорится в статье, соавторами которой являются известные ученые в области ИИ Йошуа Бенгио и Стюарт Рассел, а также профессор права и бывший советник OpenAI Джиллиан Хэдфилд.

«Я надеюсь, что мы доказали, что людям в правительстве (нужно) начать серьезно думать о том, какие именно нормативные акты нам нужны для решения этой проблемы», — сказал Коэн. Пока же «правительства знают только то, что эти компании решили им рассказать».

Слишком законно, чтобы бросить AGI?

Учитывая, что на обещаниях развития ИИ крутятся огромные деньги, неудивительно, что AGI также становится корпоративным «жужжащим» словом, которое иногда вызывает квазирелигиозный пыл.

Это слово разделило мир технологий на тех, кто утверждает, что его следует развивать медленно и осторожно, и тех, кто, включая венчурных капиталистов и рэпера MC Hammer, объявил себя частью лагеря «ускорителей».

Лондонский стартап DeepMind, основанный в 2010 году и ныне входящий в состав Google, был одной из первых компаний, которые явно поставили перед собой цель разработать AGI. OpenAI сделала то же самое в 2015 году, взяв на себя обязательства по обеспечению безопасности.

Но теперь может показаться, что все остальные вступают в игру. Соучредитель Google Сергей Брин недавно был замечен в калифорнийском заведении под названием AGI House. А менее чем через три года после того, как компания Meta Platforms сменила название на Facebook, чтобы сосредоточиться на виртуальных мирах, в январе она заявила, что AGI также находится в числе приоритетных направлений ее деятельности.

Генеральный директор Meta Марк Цукерберг заявил, что долгосрочной целью его компании является «создание полноценного общего интеллекта», для чего потребуются достижения в рассуждениях, планировании, кодировании и других когнитивных способностях. Хотя в компании Цукерберга уже давно работают исследователи, сосредоточенные на этих вопросах, его внимание ознаменовало изменение тона.

В Amazon одним из признаков нового подхода стало то, что главный научный сотрудник голосового помощника Alexa сменил должность и стал главным научным сотрудником по AGI.

Хотя для Уолл-стрит это не так ощутимо, как генеративный ИИ, трансляция амбиций AGI может помочь набрать талантливых специалистов в области ИИ, у которых есть выбор, где работать.

Выбирая между «институтом ИИ старой школы» и тем, чья «цель — создание AGI» и у которого достаточно ресурсов для этого, многие выберут последний, говорит Ты, исследователь из Университета Иллинойса.

Дополнительная информация: Michael K. Cohen et al, Regulating advanced artificial agents, Science (2024). DOI: 10.1126/science.adl0625